Deepfake-technologie laat je video's al typend aanpassen

© Stanford University

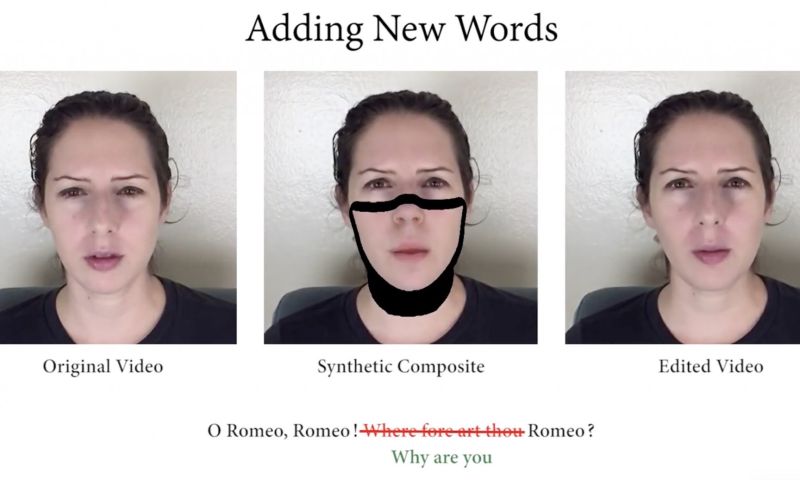

Via een nieuwe kunstmatige intelligentie is het mogelijk om gedeeltes van zinnen te veranderen die iemand uitspreekt in een video.

In een samenwerking van Adobe Research, Stanford University, the Max Planck Institute for Informatics en Princeton University hebben onderzoekers een nieuwe kunstmatige intelligentie ontwikkeld die de verontrustende deepfakes-technologie weer een stap verder brengt, zo schrijft The Verge Bij deepfakes worden gezichten in video's kunstmatig aangepast zodat gezichten kunnen worden vervangen of dat de personen in de video woorden zeggen die ze nooit gezegd hebben.

De SIGGRAPH 2019 Paper toont een technologie waarbij de uitgesproken tekst van een persoon op video kan worden aangepast in wat dan ook. Wijzigingen kunnen gewoon door middel van typen worden toegepast. Zo geven de onderzoekers het voorbeeld van een persoon die de bekende Apocalypse Now-quote, "I love the smell of napalm in the morning" zegt, aangepast wordt tot "I love the smell of french toast in the morning."

Het werkt doordat het algoritme in het bronmateriaal op zoek gaat naar vergelijkbare klanken, waarna deze worden samengevoegd tot woorden. Ook weet het wat voor soort mondbewegingen daarbij horen. De aanpassing van de onderkant van het hoofd (de mond) en de bovenkant wordt later weer zorgvuldig in elkaar geplakt

Deze technologie heeft nog wel wat mankementen. Zo zijn op dit moment alleen nog gedeeltes van zinnen aan te passen en is het moeilijk om de intonatie te veranderen. Ook is er nu nog 40 minuten aan bronmateriaal nodig om een geloofwaardige nepvideo te maken. Waarschijnlijk zijn die overkomelijke problemen.

Gevaarlijk?

In de paper worden de mogelijkheden van de technologie besproken. Zo denken de onderzoekers dat het handig kan zijn bij de editing van films, als een acteur zich verspreekt. Ook zou het kunnen helpen bij het naadloos nasynchroniseren van films.

Op dit moment is het niet voor consumenten beschikbaar, maar grote kans dat dit binnenkort wel zo zal zijn. Dan krijgen niet-techneuten de kans om in een handomdraai nepvideo's te produceren.

De onderzoekers erkennen dat de technologie gevaren met zich mee brengt. Volgens hen is het belangrijk dat de kijker altijd op de hoogte gebracht wordt dat hij/zij naar een gegenereerde video kijkt. De kans is klein dat dit daadwerkelijk gebeurt als kwaadwillenden er mee aan de slag gaan. Ook roepen de onderzoeken 'de community' op om detectiesoftware te ontwikkelen.