©Unsplash

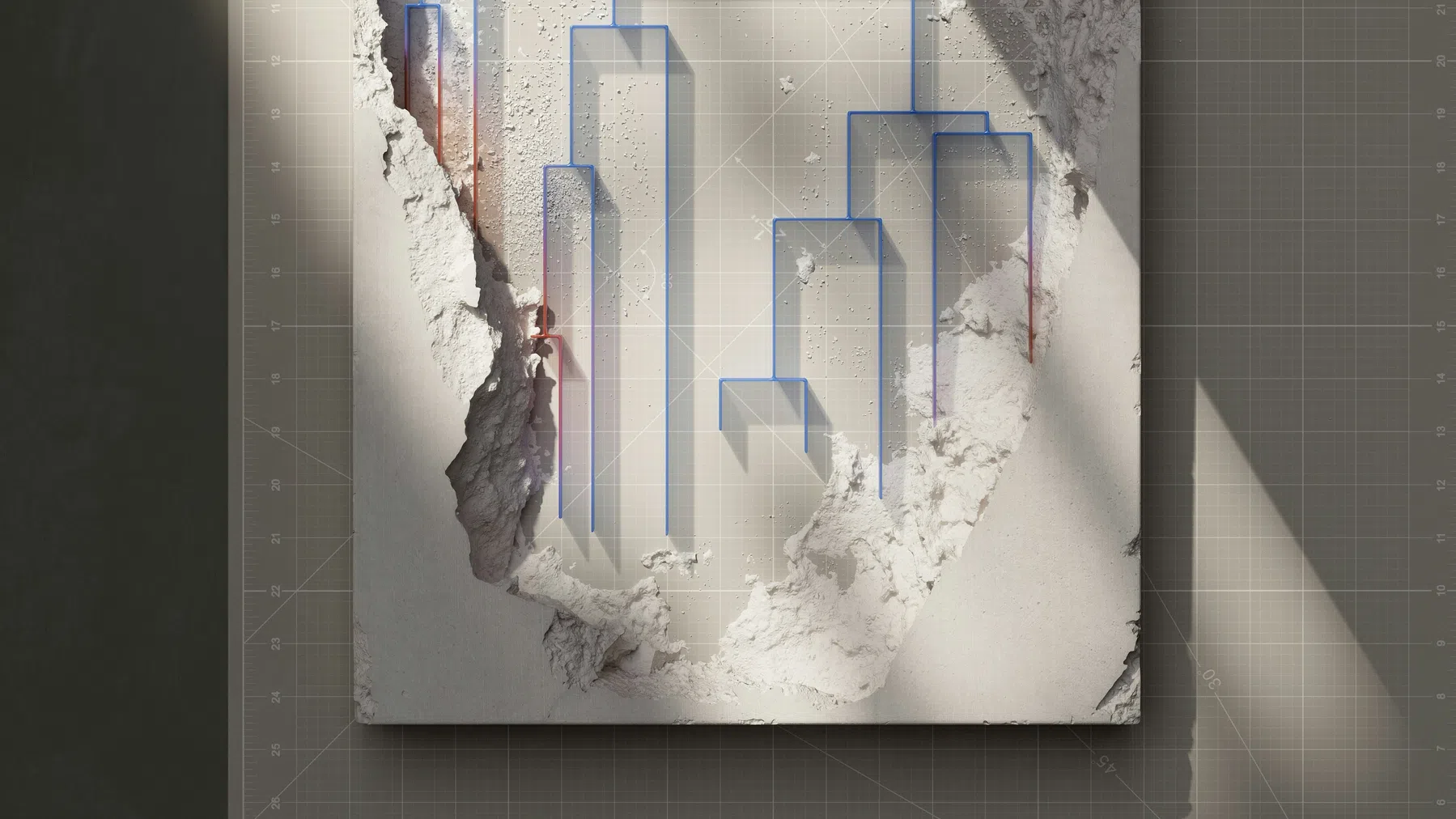

Publiekelijke data om AI mee te trainen raakt op en dat heeft grote gevolgen

Voor het trainen van AI wordt een hoop data gebruikt, maar nu blijkt uit een nieuwe studie dat publiekelijk beschikbare data dreigt op te raken en dat heeft grote gevolgen.

Het opdrogen van data die geschikt zijn voor het trainen van AI heeft grotendeels te maken met bronnen die AI-modellen ervan weren om hun artikelen of afbeeldingen te gebruiken. Dat blijkt uit een studie van de Data Provenance Initiative.

Voor deze studie is naar 14.000 verschillende webdomeinen gekeken die in in veel gebruikte datasets worden opgenomen. Het blijkt dat 5 procent van alle data en 25 procent van de data uit bronnen van hoge kwaliteit al achter een technologische muur zit. Menig andere website heeft restricties in de gebruiksvoorwaarden opgenomen.

Deals sluiten

Sommige partijen, zoals Reddit, The Associated Press en News Corp., sluiten deals met AI-bedrijven, die dan tegen betaling gebruik mogen maken van hun data. Meestal kan een andere AI-partij er dan niet meer bij.

De onderzoekers denken dat het opdrogen van data daarom voornamelijk grote gevolgen heeft voor kleinere AI-bedrijfjes en academische onderzoekers die afhankelijk zijn van publiekelijk beschikbare data. Het kan ervoor zorgen dat de ontwikkeling van de technologie steeds meer in handen komt te liggen van de grootste bedrijven die genoeg geld hebben.

Sommige AI-bedrijven denken hun AI ook te kunnen trainen met data gegenereerd door AI, maar volgens The New York Times is er veel twijfel of AI genoeg kwaliteitsdata kan maken om door mensen gecreëerde data te vervangen.

Lees meer kunstmatige intelligentie, of blijf op de hoogte via de Bright Nieuwsbrief.